La viralización de la guerra: cuando memes y juegos deshumanizan el conflicto

El auge de memes, videos e IA convierte la guerra en entretenimiento; exigimos auditoría, publicación de algoritmos y debate parlamentario sobre la propaganda digital.

Los memes y los videos que tratan la guerra como un juego no son anécdota: según La Nación (29/4/2026), la portavoz de la Casa Blanca Karoline Leavitt celebró que ciertos videos sobre operaciones sumaron más de 2.000 millones de vistas, y reportes de 2022 consignaron que la leyenda del ‘Fantasma de Kiev’ totalizó 200 millones de vistas en TikTok. Esta nota señala que la transformación estética de la violencia ya dejó de ser marginal y exige políticas públicas claras.

La deshumanización viral: qué está pasando

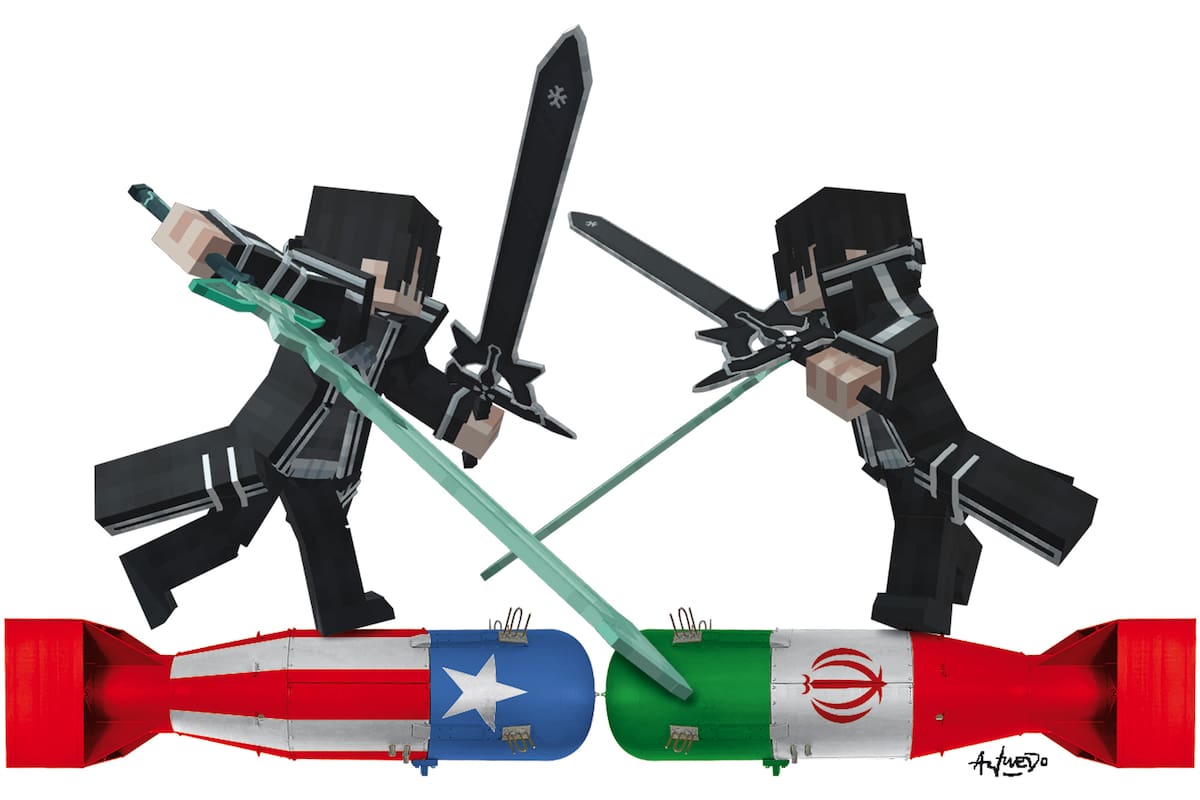

Observamos una transformación comunicacional en dos planos: por un lado, la reproducción automática de imágenes reales de bombardeos y hambruna; por otro, la hibridación con estéticas de videojuego y animación que convierten actores y víctimas en figurines. El texto base denuncia ejemplos concretos: la leyenda del ‘Fantasma de Kiev’ (200 millones de vistas, reportes de 2022 citados por La Nación) y videos generados por IA que representan líderes como muñecos de Lego. A ese cuadro se suma el uso de discursos públicos como espectáculo—el paper del Institute for International and Security Affairs (SWP) documenta “más de una decena” de amenazas nucleares públicas desde 2022—y la amplificación instantánea de todo por plataformas que monetizan la viralidad. El resultado no es sólo insensibilización: es una arquitectura de aceptación que borra fronteras entre información, propaganda y entretenimiento.

¿Por qué nos debe importar a los argentinos?

No es una clave externa: las audiencias mexicanas, europeas o argentinas participan del mismo circuito que normaliza el conflicto. Argentina tiene alrededor de 46 millones de habitantes (INDEC, estimación 2023) y niveles de penetración de Internet que convierten cualquier contenido viral en asunto de alcance nacional. Además, ya vimos cómo fenómenos digitales movilizan actos masivos: en un ejemplo extremo citado por La Nación, una convocatoria lúdico-protestaria en Telegram atrajo a 15.000 inscritos, según Vice; no se trata sólo de números, sino de cómo se organiza la acción colectiva. Por eso decimos que esto nos concierne: porque la plataforma que banaliza una masacre aquí puede incitar una reacción política allá, y porque la simetría entre espectáculo y poder erosiona la deliberación pública. Aplicamos la misma regla que usamos con la salud o la administración pública: transparencia y control democrático.

Qué proponemos: publicación, auditoría y debate parlamentario

Vemos imprescindible que no se delegue el control ético solo a empresas privadas. Exigimos la publicación de algoritmos relevantes para ranking y promoción de contenidos con impacto bélico; pedimos una auditoría independiente sobre campañas de desinformación y propaganda que usen IA, memes o videojuegos; y reclamamos un debate parlamentario amplio que defina límites y responsabilidades. No se trata de censura automática sino de reglas: identificación clara de contenido patrocinado por estados o actores políticos, obligación de preservar metadatos y trazabilidad de los generadores de IA, y sanciones proporcionales a la manipulación deliberada. Si en otros temas exigimos expedientes y auditorías públicas, aquí la coherencia exige exactamente lo mismo: rendición de cuentas sobre lo que convierte la guerra en espectáculo. El primer paso es sencillo y democrático: que los legisladores pidan los datos a plataformas y a los gobiernos, y que esos expedientes estén disponibles para auditoría ciudadana.